Muitas empresas brasileiras acreditam que estão em conformidade com a Lei Geral de Proteção de Dados simplesmente porque assinaram políticas, revisaram termos e nomearam um encarregado. Essa percepção, além de equivocada, é perigosa. Neste artigo, analisamos por que a adequação à LGPD exige muito mais do que burocracia jurídica, o que significa construir uma cultura real de privacidade e como o avanço da inteligência artificial torna essa discussão ainda mais urgente.

A armadilha do checklist

Existe uma tendência consolidada no mercado corporativo de tratar a conformidade regulatória como um projeto com data de início e término. Define-se um escopo, contrata-se uma consultoria, produzem-se documentos e declara-se a empresa adequada. Com a LGPD, esse raciocínio é particularmente problemático.

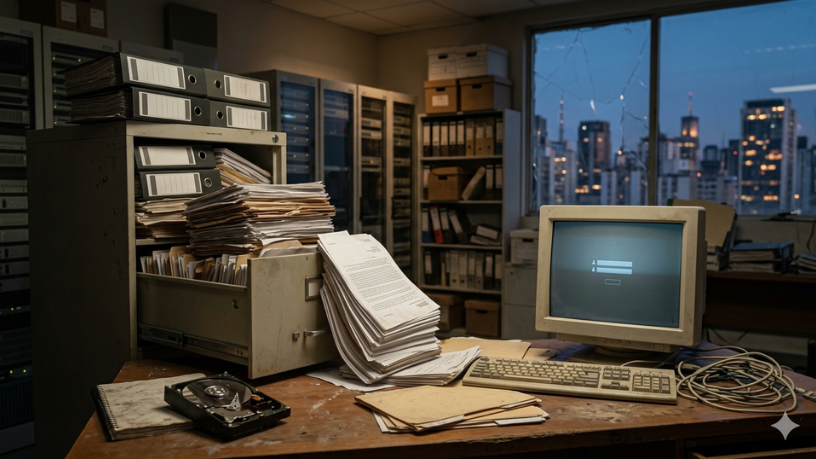

A lei não é um conjunto estático de obrigações. Ela pressupõe uma gestão contínua de dados pessoais, com processos vivos, responsabilidades distribuídas e capacidade de resposta a incidentes. Uma empresa que possui políticas de privacidade bem redigidas, mas sem monitoramento real de como os dados circulam internamente, tem a mesma vulnerabilidade de quem nunca se adequou. A diferença é que a primeira possui uma falsa sensação de segurança, o que pode ser ainda mais prejudicial.

O problema está na confusão entre forma e substância. Ter documentos revisados é a forma. A substância é saber, em tempo real, quais dados são coletados, onde estão armazenados, quem tem acesso a eles e o que acontece quando algo dá errado.

O cenário de ameaças que torna isso urgente

O Brasil permanece entre os países mais afetados por incidentes de segurança da informação no mundo. Somente no primeiro semestre de 2025, foram registradas centenas de bilhões de atividades maliciosas direcionadas ao país. Esse volume não é abstrato: ele representa tentativas concretas de acesso não autorizado a sistemas de empresas de todos os portes e setores.

Paralelamente, a judicialização envolvendo a LGPD cresce de forma consistente. Consumidores e titulares de dados estão mais informados sobre seus direitos, e a Autoridade Nacional de Proteção de Dados amplia progressivamente sua atuação fiscalizatória. O ambiente regulatório que existia em 2020, quando a lei entrou em vigor, é radicalmente diferente do que existe hoje. Empresas que não acompanharam essa evolução estão expostas a sanções que podem chegar a 2% do faturamento anual, além de danos reputacionais difíceis de reverter.

Inteligência artificial e o novo nível de complexidade

O avanço acelerado da inteligência artificial introduz uma camada adicional de risco para as organizações. Ferramentas de IA processam volumes massivos de dados para funcionar, o que inclui, frequentemente, dados pessoais e sensíveis. Quando uma empresa adota soluções de IA sem governança de dados adequada, ela amplia sua superfície de exposição de forma desproporcional ao benefício que obtém.

Esse ponto merece atenção especial porque a adoção de IA corporativa cresceu muito mais rápido do que as estruturas de compliance das empresas. A maioria das organizações que hoje usa modelos de linguagem, automação de processos ou análise preditiva ainda não mapeou adequadamente como essas ferramentas interagem com os dados pessoais que circulam em seus sistemas.

O que uma abordagem estruturada realmente exige

Tratar a LGPD de forma séria significa, antes de tudo, mapear o ciclo de vida dos dados pessoais dentro da organização. Saber quais dados são coletados, com qual finalidade, onde ficam armazenados e com quem são compartilhados não é uma tarefa pontual, mas um processo que precisa ser revisado à medida que os negócios evoluem.

Além do mapeamento, é indispensável classificar riscos de forma honesta. Nem todos os dados têm o mesmo nível de sensibilidade, e os esforços de proteção precisam ser proporcionais à criticidade de cada informação. Isso exige uma postura analítica, não apenas administrativa.

Por fim, e talvez o elemento mais frequentemente negligenciado, a conformidade depende de cultura organizacional. Políticas que existem no papel, mas não são compreendidas pelas equipes, não protegem ninguém. Erros humanos seguem sendo uma das principais causas de incidentes de segurança, o que torna o investimento em conscientização tão estratégico quanto o investimento em tecnologia.

Empresas que compreendem isso saem na frente: não apenas evitam sanções, mas constroem um ativo intangível valioso em um mercado cada vez mais orientado pela confiança digital.

Autor: Diego Velázquez